A voir également:

- Comment un GPU calcul les images a partir des donnés binaire?

- Creer un groupe whatsapp a partir d'un autre groupe - Guide

- Binaire - Guide

- Créer une icone à partir d'une image - Guide

- Gpu z - Télécharger - Informations & Diagnostic

- Comment faire une recherche à partir d'une photo - Guide

1 réponse

Bonjour,

Commençons à l'envers et voyons comment une image est codée en binaire ^^

Un bit est l'unité élémentaire 1 ou 0

Un octet est un ensemble de 8 bits qui peut donc coder 2^8 = 256 valeurs, de 0 à 255 en décimal ou de 00000000 à 11111111 en binaire

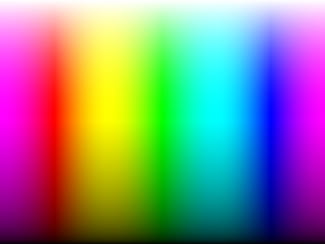

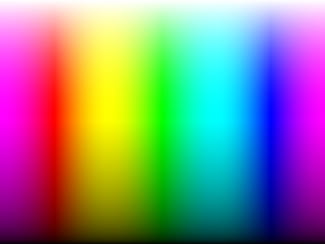

Un pixel est "constitué" d'un groupe de 3 couleurs (couleurs RVB par exemple) le rouge, le vert et le bleu. En choisissant d'utiliser 256 nuances par couleur ( codables sur un octet, palette 8 bits ) cela nous donne 256x256x256 = 16 777 216 couleurs possibles, toutes différentes.

ex :

Couleur noire 3 octets à 0

Couleur blanche 3 octets à 255

Couleur rouge 1 octet à 255 et deux octets à 0

Couleur verte un octet à 0, un octet à 255 et un octet à 0

Couleur bleu 2 octets à 0 et 1 octet à 255

Toutes les images rendues sont matricelles. Imaginons une image de 800px par 600px alors nous avons 800 * 600 = 480 000 "pixels" constitués chacun de trois octets constitués chacun de 8 bits ce qui donne 480 000 * 3 * 8 = 11 520 000 informations binaires. Ce fichier image sera donc constitué d'une suite de 0 et de 1, une longue chaine de 11 520 000 informations binaires

Un Kilo octet est égal à 1024 octets, la taille absolue de notre image sera donc de 11 520 000 / 1 024 = 11,25 Ko

A la question posée : "...comment un GPU calcule les images a partir des donnés binaire??"

tres shematiquement, le GPU lit sequentiellement les données binaires du fichier image et selon plusieurs parametres ( taille de l'image, palette, le mode de compression, etc ) reconstitue la couleur de chaque pixel l'un apres l'autre, point par point.

Imaginons un ecran d'hier, de 800px * 600px, une palette de 8 bits et un taux de raffraichiseement de 60Hz le GPU aura 691 200 000 unités binaires ( 0 ou 1 ) à traiter par seconde, pratiquement 700 milliards / seconde, mais ça c'était à l'époque

Imaginons un ecran d'aujourd'hui offrant une resolution de 1920 *1080 avec une palette de 32 bits et un taux de raffraichissement de 60 Hz je vous laisse imaginer le nombre de 0 et de 1 que le GPU doit traiter par seconde ...

Et demain ???

Cdt

ps -> c'est du tres tres succin, je réclame votre indulgence : )

pour aller plus loin :

https://fr.wikipedia.org/wiki/Codage_informatique_des_couleurs

https://fr.wikipedia.org/wiki/Trichromie

En informatique 99% des problèmes se situent entre le fauteuil et le clavier

Commençons à l'envers et voyons comment une image est codée en binaire ^^

Un bit est l'unité élémentaire 1 ou 0

Un octet est un ensemble de 8 bits qui peut donc coder 2^8 = 256 valeurs, de 0 à 255 en décimal ou de 00000000 à 11111111 en binaire

Un pixel est "constitué" d'un groupe de 3 couleurs (couleurs RVB par exemple) le rouge, le vert et le bleu. En choisissant d'utiliser 256 nuances par couleur ( codables sur un octet, palette 8 bits ) cela nous donne 256x256x256 = 16 777 216 couleurs possibles, toutes différentes.

ex :

Couleur noire 3 octets à 0

Couleur blanche 3 octets à 255

Couleur rouge 1 octet à 255 et deux octets à 0

Couleur verte un octet à 0, un octet à 255 et un octet à 0

Couleur bleu 2 octets à 0 et 1 octet à 255

Toutes les images rendues sont matricelles. Imaginons une image de 800px par 600px alors nous avons 800 * 600 = 480 000 "pixels" constitués chacun de trois octets constitués chacun de 8 bits ce qui donne 480 000 * 3 * 8 = 11 520 000 informations binaires. Ce fichier image sera donc constitué d'une suite de 0 et de 1, une longue chaine de 11 520 000 informations binaires

Un Kilo octet est égal à 1024 octets, la taille absolue de notre image sera donc de 11 520 000 / 1 024 = 11,25 Ko

A la question posée : "...comment un GPU calcule les images a partir des donnés binaire??"

tres shematiquement, le GPU lit sequentiellement les données binaires du fichier image et selon plusieurs parametres ( taille de l'image, palette, le mode de compression, etc ) reconstitue la couleur de chaque pixel l'un apres l'autre, point par point.

Imaginons un ecran d'hier, de 800px * 600px, une palette de 8 bits et un taux de raffraichiseement de 60Hz le GPU aura 691 200 000 unités binaires ( 0 ou 1 ) à traiter par seconde, pratiquement 700 milliards / seconde, mais ça c'était à l'époque

Imaginons un ecran d'aujourd'hui offrant une resolution de 1920 *1080 avec une palette de 32 bits et un taux de raffraichissement de 60 Hz je vous laisse imaginer le nombre de 0 et de 1 que le GPU doit traiter par seconde ...

Et demain ???

Cdt

ps -> c'est du tres tres succin, je réclame votre indulgence : )

pour aller plus loin :

https://fr.wikipedia.org/wiki/Codage_informatique_des_couleurs

https://fr.wikipedia.org/wiki/Trichromie

En informatique 99% des problèmes se situent entre le fauteuil et le clavier

Vous aurez compris que ce n'est pas 700 milliards mais 700 millions :)

Oui. Tous les fichiers sont stockés en binaire sur ton HD